ההתמודדות עם ביטויי שנאה (Hate Speech) נגד קבוצות באוכלוסייה או אנשים המשתייכים אליהן היא אחד האתגרים הגדולים היום עבור רשתות חברתיות. היא מעלה דילמות רבות - כמו איפה עובר הגבול בין התבטאויות קשות או אלימות שיש לחסום, לבין כאלה שיש לאפשר במסגרת חופש הביטוי; השאלה האם ההחלטה הזו צריכה בכלל להיות בידיהן של חברות פרטיות ועוצמתיות כמו פייסבוק וגוגל; והאתגר הטכנולוגי המשמעותי בזיהוי של תכנים בעייתיים על-ידי אלגוריתמים אוטומטיים.

מחקר מדיניות חדש של המכון הישראלי לדמוקרטיה שנעשה בשיתוף עם "יד ושם", מנסה לענות על השאלות הללו בדיוק, ולעזור לרשתות חברתיות בהתמודדות עם ביטויי שנאה. "ביטויי שנאה הם תופעה חברתית מאוד קשה", הסבירה ד"ר תהילה שוורץ-אלטשולר, ראש התוכנית לדמוקרטיה בעידן המידע במכון הישראלי לדמוקרטיה, שכתבה את המחקר יחד עם עו"ד רותם מדזיני, בראיון ל"גלובס". "בגלל הרשתות החברתיות, ביטויי שנאה מגיעים היום להרבה יותר אנשים, ויש גם יכולת להפנות אותם לאוכלוסיות ספציפיות ועל-ידי זה מאוד להגדיל את הפגיעה בהן. ביטויי השנאה ברשתות החברתיות נותנים לאנשים תחושה שיש עוד אנשים כמוהם, מה שלפעמים מוביל למעשים. במקרים אחרים, נוצר סוג אחר של נזק, כמו להשתיק אחרים או לגרום להם להרגיש לא נוח".

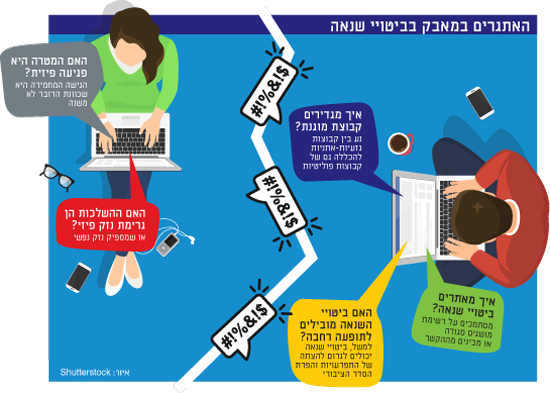

האתגרים במאבק בביטויי שנאה

לדברי שוורץ-אלטשולר, אחת ממטרות המחקר היא לארגן את עולם ביטויי השנאה לקריטריונים שונים ולהציג סקאלות של אפשרויות עבור כל אחד, באופן שיסייע לרשתות החברתיות להציג מדיניות ברורה ושקופה כלפי המשתמשים. כך למשל, הסקאלה הראשונה מבקשת מרשתות חברתיות להגדיר מהי מבחינתן קבוצה מוגנת - כלומר כזו שאסור להפנות נגדה ביטויי שנאה. בקצה הסקאלה נמצאת מדיניות פחות מחמירה לפיה קבוצות אתניות-דתיות בלבד הן מוגנות, ולפיכך התבטאויות אנטישמיות, אסלאמופוביות, או כאלה המבטאות שנאת שחורים, למשל - הן אסורות. האפשרות שבמרכז הסקאלה תוסיף גם איסור ביטויי שנאה כלפי קבוצות כמו נכים, ניצולי שואה או להט"בים, כאשר האופציה המחמירה ביותר היא לאסור גם על התבטאויות נגד אנשים בשל השתייכותם לקבוצות פוליטיות, כגון חברי איגודים מקצועיים או פמיניסטיות. לדברי שוורץ-אלטשולר, במצב הקיים היום מאוד מסובך לדעת אם קבוצה מסוימת נחשבת מוגנת בפלטפורמות השונות, כיוון שהרשתות החברתיות לא מייצרות רשימות שקופות בעניין.

מטרת הקריטריונים שהמחקר מגדיר היא להחיל עולם מושגים אחיד על הרשתות החברתיות, כך שכל פלטפורמה תוכל להגדיר אילו תכנים היא מאפשרת ואילו לא באופן שיהיה שקוף למשתמשים - ויציב את המדיניות שלה באופן ברור ביחס למדיניות של פלטפורמות אחרות. "ככה בתור צרכנית תהיה לי אפשרות להגיד שאני רוצה להיות בפלטפורמה מסוימת ולא בפלטפורמה אחרת", מסבירה שוורץ-אלטשולר. "במסגרת המחקר, בדקנו מהם תנאי הקהילה ותנאי השימוש של הרשתות הגדולות לגבי ביטויי שנאה - ומצאנו בעיקר בלגן. זה מופיע בכל מיני מקומות, כל מדיניות כתובה במילים שונות, ומאוד קשה לדעת איך מיישמים את המדיניות. קשה להבין איזו רשת חברתית יותר מקלה או מחמירה בהקשרים שונים, ולהשוות בין המדיניות של פלטפורמות שונות".

"הרשתות הפכו לשומרי הסף של השיח הציבורי"

הסקאלות הוגדרו לאחר בחינה של אמנות בינלאומיות וחוקים מדינתיים הנוגעים לביטויי שנאה, וכן בחינת המדיניות של הרשתות החברתיות הגדולות, בניסיון למצוא מכנים משותפים. בנוסף לסקאלה הקשורה לקבוצות מוגנות, הוגדרו ארבע סקאלות נוספות.

הסקאלה השנייה נוגעת לאופן בו בודקים האם תוכן מסוים אכן מבטא שנאה באמצעות טכנולוגיית עיבוד שפה טבעית: האפשרות הראשונה והפחות מתוחכמת, היא להגדיר רשימות סגורות של מושגים וסמלים אסורים, כמו צלב קרס, המתעדכנת ביחס לביטויים חדשים בשיח. אפשרות האמצע היא ניתוח מעמיק יותר של הטקסט לפי הסנטימנט העולה ממנו, צמידות של מילים ועוד - כך למשל, אם באפשרות הראשונה המילה "כושי" או "כושית" תיאסר תמיד בשל היותה ביטוי גזעני, באפשרות השנייה ייבדק אם קיימת סמיכות למילה "עוגה", ובמקרה כזה יותר השימוש. האפשרות השלישית - ששוורץ-אלטשולר מסבירה כי מבחינה טכנולוגית עדיין אינה ישימה - היא גישה מבוססת הקשר, שבוחנת לעומק טקסט שמכיל ביטויי שנאה ובודקת האם מדובר בסאטירה, בתוכן בעל ערך חדשותי או היסטורי, וכן לוקחת בחשבון פקטורים כמו סטטוס הדובר, קהל היעד, או היסטוריה של אלימות באזור הגיאוגרפי בו מתרחש השיח - כדי לקבוע האם הוא מסוכן.

שוורץ-אלטשולר מדגישה כי לסקאלות השונות, ולזו בעיקר, יש גם השלכות טכנולוגיות חשובות. "אנחנו מצפים היום מהפלטפורמות להשתמש בטכנולוגיה ולא רק בבודקים אנושיים, והדבר הכי קשה בעיבוד שפה טבעית זה ההקשר. לגישה שכל פלטפורמה תבחר יש השלכות על הטכנולוגיה שתאמץ ורמת ההשקעה במחקר ופיתוח".

סקאלה נוספת בוחנות שאלות כמו האם ביטוי השנאה צריך לגרום נזק כדי שייאסר, ואם כן איזה סוג של נזק - פיזי, נפשי ועוד; האם צריך לבדוק אם לדובר הייתה כוונה לגרום נזק; והאם הביטוי מנסה לגרום לתופעה חברתית לא רצויה - אלימה או אחרת.

כל עוד יש הסתמכות על בודקי תוכן אנושיים, אשר מתחקירים עולה שהם צריכים לעבוד בתנאים קשים ולהגיע להחלטות לגבי תכנים מהר מאוד - עד כמה המודל הזה ישים?

"דווקא בגלל זה המעבר לניתוח תוכן על-ידי טכנולוגיה והשאלה איך יפתחו את הטכנולוגיה בוערים. אם ניקח את התפיסות הקיימות של הפלטפורמות על ביטויי שנאה בלי לחלק אותן לחלקים האלה, לא נצליח ללמד את המכונה בצורה טובה, וגם כשהיא תלמד זה יהיה עם המון הטיות. עכשיו צריך לטפל בזה כי עכשיו מלמדים את המכונות".

שוורץ-אלטשולר מדגישה את מורכבות הנושא ומסבירה כי "האופן שבו עושים את ניטור התוכן וההכרעות לגביו - זו לדעתי אחת הדילמות המשפטיות הכי גדולות של הדור הזה. אנחנו מנסים להכניס את הידיים לבוץ ולהתחיל למצוא חוטים. זו לא עבודה קלה והיא גם התחלתית - אבל חייבים להתחיל לדבר על זה". לדבריה, החשיבות הגדולה בשיח בנוגע לאופן הפיקוח על התכנים נובעת מכך ש"הרשתות הפכו להיות שומרי הסף של השיח הציבורי".

אבל האם הרשתות החברתיות בכלל צריכות לקבוע בעצמן את גבולות השיח, או שזה עניין ממשלתי? אפילו צוקרברג עצמו כבר קורא לרגולציה בנושא.

"יש בי משהו שאומר שחברה פרטית למטרות רווח לא צריכה לקבל החלטות על גבולות חופש הביטוי ושזה צריך להיות תהליך דמוקרטי בכל מדינה. אבל אם נשאיר את זה בידיה של כל מדינה נייצר איים של סמכויות שיפוט, וזה ייצור בעיה ביכולת לנהל שיח בינלאומי. זה ייקח מאיתנו את אחד המאפיינים הכי חשובים של האינטרנט כמו שהוא היום. בנוסף, אני לא רוצה שפקידים יהיו אחראים לשאלה איזה תוכן צריך להיות ברשת החברתית ואיזה דברים מותר להגיד עליהם. בישראל, להנהלת בתי המשפט יש תפיסה שעל שופטים אסור להעביר שום ביקורת. לכן היא התחילה לעשות דברים כמו לשלוח לאנשים הודעות מאיימות שהם חייבים להסיר פוסטים. מצד שני, אנחנו גם לא יכולים להשאיר הכול לפלטפורמות הגדולות". שוורץ-אלטשולר מציעה מודל של שיתוף-פעולה בין הרשויות והחברות הפרטיות: "אני באה מהעולם של מדיניות תקשורת, והמודלים שהכי הצליחו ברגולציית תוכן הם הקו-רגולטורים - כשיש שיתוף-פעולה בין המחוקק המדינתי והגוף שמפקחים עליו. התפיסה לפיה האינטרנט יהיה 'no man's land' כבר נגמרה. יש מרחבים שצריך לטפל בהם ברמה הרגולטורית. אנחנו שואלים עכשיו איך אפשר לעשות את זה הכי טוב, כך שלא נקלקל יותר ממה שנתקן".

שוורץ-אלטשולר מוסיפה כי "הסקאלות האלה גם יעזרו לקהילה המחקרית, לציבור ולמחוקקים להשוות בין ההגדרות של הרשתות החברתיות ובין חקיקה של מדינה, וכך השיח יהיה יותר ענייני. הרעיון הוא למצוא את המכנים המשותפים. יהיו שינויים מסוימים באופן ניטור התוכן בין מדינות, אבל השיח פחות או יותר השיח אמור להיות אותו שיח".

ועדה של פייסבוק תייעץ בסכסוכי תוכן

ההמלצות של שוורץ-אלטשולר נוגעות דווקא לפלטפורמות המיינסטרים - פייסבוק, יוטיוב, אינסטגרם וטוויטר, למרות שפלטפורמות שוליים כמו גאב ו-8chan עוררו ביקורת רבה לאחר שמשתמשים פרסמו בהן מניפסטים רוויי ביטויי שנאה - רגע לפני שיצאו למסע ירי המוני. רק לאחרונה זה קרה ב-8chan בפעם השלישית, עם היורה מאל פאסו שבטקסס. רשתות חברתיות אלה מקדשות את חופש הביטוי וכמעט ולא מבצעות סינון תוכן, אך בפועל מושכות אליהן קיצונים. שוורץ-אלטשולר מסבירה כי "האנשים האלה לא מגיעים ל-8chan מיד. הם מתחילים ברשתות המיינסטרים. צריך לטפל ברשתות המיינסטרים כי זה מתחיל שם, וכי ההמונים נמצאים שם. בקיצונים צריך לטפל בכלים אחרים מאשר במיינסטרים. מבחינתי ההצדקה המשפטית לנהל מעקב אחרי קבוצה מסוימת ב-8chan היא אחרת מאשר בפייסבוק. דווקא במובן הזה, לטפל ב-8chan זה הסיפור הקל מבחינה משפטית - לעומת הרשתות בהן נמצא שיח המיינסטרים, שגם הוא יכול לפגוע או לגרום להרבה מאוד נזק".

שוורץ-אלטשולר מסבירה כי התפיסה לפיה הרשתות החברתיות מהוות פלטפורמה בלבד - ולכן לא אחראיות לתוכן שהמשתמשים מעלים - מתחילה לעבור מהעולם. "חלק מחברי הקונגרס בארה"ב הולכים לכיוון קיצוני ואומרים שצריך לבטל את סעיף 230 ב-Online Decency Act (חוק ההוגנות ברשת משנות ה-90) - שמעניק פטור לפלטפורמה מהאחריות לתוכן שנמצא אצלה. בלי הסעיף הזה, רשתות חברתיות היו צריכות לבדוק מראש כל דבר לפני שהוא מתפרסם, ולא היו מתפתחות באופן שאנחנו מכירים היום. אבל במקום ללכת על דברים קיצוניים כמו ביטול הסעיף, בהקשר של ביטויי שנאה צריך פשוט ליצור קריטריונים מהותיים כמו הסקאלות האלה, וגם שיטת שיפוט יותר טובה בשאלה איך מיישמים אותם".

פן נוסף במחקר אליו מתייחסת שוורץ-אלטשולר הוא אותו אופן יישום - שלדבריה עדיין אינו שקוף מספיק. בעוד שבשלוש השנים האחרונות הפלטפורמות נהיו שקופות יותר לגבי המדיניות שלהן, היא מסבירה כי אופן היישום, לצד נימוק פעולות של הרשתות בפני הגולשים ואפשרות לערער עליהן, עדיין אינם שקופים דיים.

כניסיון להתמודד עם נושא יישום המדיניות, פייסבוק פועלת להקמת Oversight Board - ועדה שתורכב ממומחים חיצוניים ששוורץ-אלטשולר מתארת כ"מעין בית משפט עליון", שתפקידו יהיה לייעץ או לקבל החלטות בסכסוכי תוכן קונקרטיים או עקרוניים ברשת החברתית. "פייסבוק מנהלת בחצי שנה האחרונה שיח מול מומחים בכל העולם כדי לקבל משוב ותובנות על איך לנהל את הוועדה, מה יהיו הסמכויות שלה, מה יקרה אם המומחים יגידו לפייסבוק משהו שלא מוצא חן בעיניה", מסבירה שוורץ-אלטשולר. "לקחתי חלק בצוות מומחים קטן שהתאסף בנושא בארץ ביוזמת פייסבוק וכלל אנשי חברה אזרחית, אנשי אקדמיה ואנשים שעוסקים בניטור תוכן בממשלה, וגם בפורום בינלאומי שהתכנס בברלין לפני כחודשיים ליומיים מאוד אינטנסיביים של דיונים עם מומחים מכל העולם. פייסבוק עוד לא פרסמה איך יראה ה-Oversight Board, אבל הכיוון הוא שיהיו בו סדרי דין של בית משפט עליון, אנשים שיוכלו לטעון לפניו, קדנציות למשתתפים, החלטות מנומקות. אני חושבת שהמחקר צריך לתת קנה-מידה לוועדה כשהיא באה לטפל בסכסוכי תוכן, ולתת לה רקע וידע בנושא. כשהשתתפתי בפורום בברלין ראיתי, למשל, שאפילו ההבדל בין רשימות מושגים אסורות לגישה מבוססת הקשר זו המשגה שלא קיימת בקרב האנשים שעוסקים בדבר - ואפילו לא בתוך פייסבוק עצמה".

אם חסמו אותי על פוסט ואני טוענת שזה לא מוצדק - אצטרך להגיע פיזית ולטעון בביהמ"ש הזה?

"יכול להיות שיהיו עורכי דין שייצגו שם, ויכול להיות שלא יגיע לשם הסיפור הספציפי שלך אלא רק הרבה סיפורים דומים, מעין תביעה ייצוגית. זו שאלה שהם עוד לא פתרו עד הסוף. אבל בדיוק כמו שכל אדם יכול להגיע לבג"ץ, הרעיון הוא שיהיה מקום שאליו אפשר לעתור ולהרגיש שלא קיבלו החלטות שרירותיות בנוגע ליכולת שלך להתבטא".

לתשומת לבכם: מערכת גלובס חותרת לשיח מגוון, ענייני ומכבד בהתאם ל

קוד האתי

המופיע

בדו"ח האמון

לפיו אנו פועלים. ביטויי אלימות, גזענות, הסתה או כל שיח בלתי הולם אחר מסוננים בצורה

אוטומטית ולא יפורסמו באתר.